[LARPSICO] Los peligros para la salud mental de la 'IA generativa': ¿nuevo caso de ciberacoso sexual profesional en el fútbol?

En la era de la digitalización de todos los mundos de vida de las personas y grupos, que incluyen el entorno privado y familiar, también el social, y, claro está, el laboral, no sorprende que una parte creciente de de las conductas vejatorias, humillantes u ofensivas, incluso acosadoras, se desplieguen a través de medios telemáticos y lugares virtuales. Al respecto, en estas páginas dimos cuenta hace pocas semanas de la STSJ Madrid 376/2024, de 16 de mayo, que validaba el despido procedente de una trabajadora de ADSMURAI S.L. en atención a probados comentarios ofensivos hacia compañeras/os de trabajo, a través de un chat corporativo de la empresa. En este caso, la responsable de esta típica conducta de violencia psíquico-moral digital es una mujer, al igual que la mayor parte de las víctimas.

Con gran frecuencia, la víctima de estas conductas, máxime cuando están dotadas de una fuerte componente sexual, no solo sexista, son mujeres, en línea con lo que sucede para la violencia sexual y el acoso por razón de sexo “analógico” o “físico”. Así lo recuerda, ahora utilizando la ficción cinematográfica, el célebre caso “Nevenka”, la primera mujer que denunció, en España, una conducta de acoso sexual y moral por parte de un político gallego muy conocido. En la magnífica cinta, que ya constituyó una serie en Netflix, se va más allá, para dar cuenta del complejo entorno sociocultural de violencia de género que da cobertura a este tipo de situaciones.

Volviendo a la contemporánea dimensión digital de la violencia y el acoso por razón de sexo en los entornos profesionales, una faceta priorizada en la lucha preventiva por el Convenio 190 OIT, ha saltado recientemente a la actualidad el caso de la árbitra turca que ha sido suspendida por protagonizar un video sexual con otro profesional del arbitraje turco (supervisor arbitral), si bien ella esgrime que ha sido víctima de una suplantación de imagen a través del recurso a la Inteligencia Artificial generativa (IA).

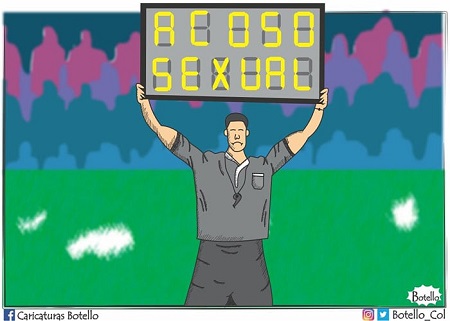

Fuente de la imagen: Caricatura: Continúa el acoso sexual en el mundo del fútbol

Lamentablemente, el fútbol profesional no escapa, ni de la violencia social ni de la violencia sexual (también la ejercida por futbolistas fuera del entorno profesional, pero por aprovechamiento de su celebridad profesional), por lo que están en el primer plano de las noticias del fútbol mundial. En el caso ahora comentado la singularidad se produciría tanto por el sector profesional afectado, las personas profesionales del arbitraje, siendo mujer la víctima, cuya presencia en este colectivo profesional es minoritaria (aunque crece ante el desarrollo del fútbol femenino -la colegiala fue primero futbolista profesional-) como por el medio utilizado, un video sexual, que, según la víctima y su defensa jurídica, no sería real, sino fabricado por IA artificial. La visión ofrecida por la Federación de Fútbol turca es muy diferente, de ahí que la haya suspendido por salir en un video sexual con su superior (supervisor u observador de árbitros, de la Federación turca y de la UEFA).

La versión de la defensa jurídica de la colegiada turca potencialmente víctima (que llevará a un procedimiento judicial) es la siguiente: "Se publicó en las redes sociales un vídeo montado, que no era el original y fue creado enteramente mediante inteligencia artificial a partir de la cuenta de otra persona en las redes sociales y no tiene ninguna relación con el cliente de ninguna manera... Cuando se examina el vídeo queda muy claro que la imagen no es clara y que las partes de la relación fueron editadas completamente por ordenador"

Por supuesto, nosotros no pretendemos mediar ni en una versión ni en otra, por lo que permaneceremos atentos a la solución judicial. La noticia nos parece relevante para poner de relieve el riesgo creciente de violencia digital y/o ciberacoso por razón de sexo también en el ámbito laboral. Por supuesto, otros sectores de actividad profesional se ven afectados, siendo difícil discernir entre la dimensión laboral y la dimensión social, como en el caso del ciberacoso sexual sufrido por una célebre cantante surcoreana, que terminó trágicamente en suicidio. Esta cantante, modelo y actriz sufría depresión, por el efecto de la presión tanto de la poderosa industria del pop coreano (K-pop) como de los fans, agravada tras la publicación en Instagram de unas fotos íntimas suyas en las que enseñaba accidentalmente sus pechos (víctima del ciberacoso social y ambiental)

Aunque no podemos detenernos aquí en esta interesante situación, si conviene dejar constancia de que la muerte de esta cantante solo es un nuevo capítulo en la lista de sucesos conflictivos relacionados con el “K-pop”. A previas muertes (o por infartos o por suicidios) de otros cantantes muy conocidos, en entornos-estados de depresión por las fuertes exigencias de la industria y la presión social de la fama desmedida a edades jóvenes de sus estrellas, se sumaría la reciente denuncia en el Parlamento coreando de un eventual contexto de acoso laboral crónico contra diversas estrellas de la industria del K-pop.

Por lo que aquí nos interesa especialmente, dentro de nuestra prioridad preventiva, es interesante recordar que todas estas situaciones deben ser objeto de políticas eficaces y protocolos adecuados de gestión. Así se prevé no solo en el Convenio 190 OIT, también en leyes recientes españolas, como la de protección integral de la libertad sexual (2022) así lo contempla de forma expresa. No es fácil la evaluación e intervención en estos casos de violencia digital y/o ciberacoso en el mundo profesional (con factores internos y externos, en la mayor parte de los casos, como se ha apuntado o ejemplificado en esta entrada). Así lo probó en su momento el caso tan tristemente célebre “IVECO”, que terminó doblemente archivado, por falta de prueba de la autoría real, sea en sede judicial como administrativa. En todo caso, sí sirve para poner de manifiesto la necesidad de incluir en los protocolos de violencia y acoso la especificidad de estas conductas, cuando se basa en el uso de datos personales (acoso digital), como también ha reconocido la Agencia Española de Protección de Datos (AEPD)

Horario de atención telefónica: de 09:00 a 14:30 horas

Compartir en

La agencia

La agencia